2026-04-08【當 AI 修了社會工程學分:誰正在悄悄閱讀你的大腦?】

【當 AI 修了社會工程學分:誰正在悄悄閱讀你的大腦?】

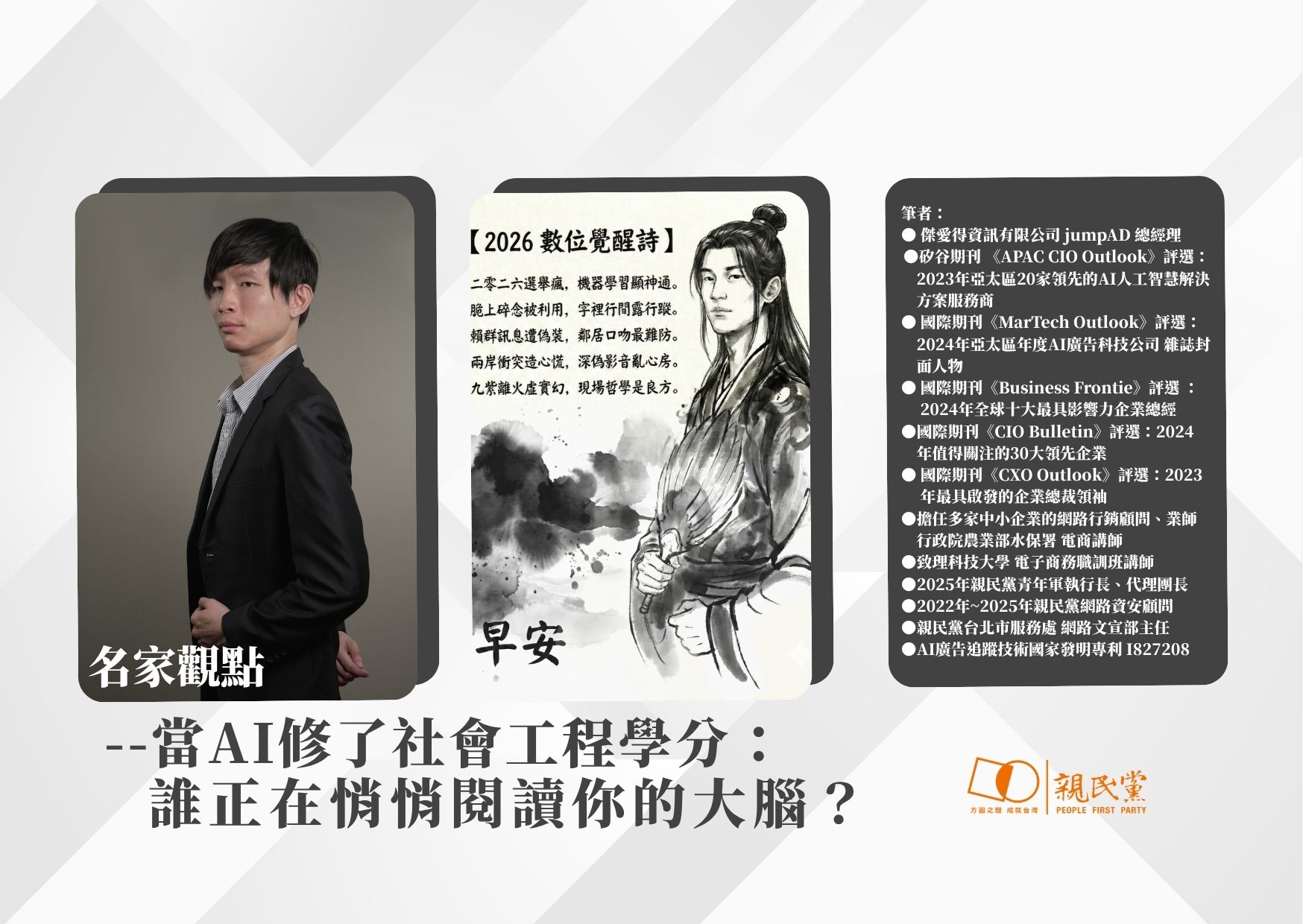

文/劉俊宏(親民黨網路顧問暨青年團執行長、台北市黨部網路部主任、傑愛得資訊總經理、AI創作YouTuber、Google Partner)

媒體報導: AI 記者 Google AI - Gemini

詩詞: 劉吉拉 與 Google AI - Gemini

圖:Google AI - Gemini 3 Pro Image(Nano Banana Pro)與劉吉拉

你的字裡行間都是寶:操盤手最愛的心理掃描儀

2026 年,最頂尖的社會工程師不再去破解主機,而是去「脆」(Threads)上面爬文。你在上面發的每一句心裡話,抱怨、幹醮、嘴砲、當下的焦慮,在 AI 眼中都不是廢文,而是最純粹的、無須再數據清理的「人格樣本」,透過 AI 繪製出每個使用者的情緒地圖,劃分族群屬性分類。

今年剛好是選舉年,選舉操盤手可能會利用 AI 掃描 Threads 上的關鍵字,自動將用戶貼上標籤。如果你常發怒文、寫幹話,AI 會把你標記為「易受激怒型」;如果你愛發感傷文,你就是「情感勒索型」。這些標籤,就是他們發動認知作戰的「狙擊座標」。

Threads 上面的內容,表達抒發情緒較高, 使用者在 Threads 上面經常發布碎碎念、情緒抒發或即時評論。這種非正式、強烈情緒的文字內容,比起官宣稿,更反映一個人的真實心理狀態。

Threads 的內容在 2026年已經高度可檢索。不管是在 App 內或是外部搜尋引擎和 AI 爬蟲都能輕鬆擷取這些公開內容。我們可以這樣形容,如果 AI 是引擎,那數據便是石油,而以文字這種最適合 NLP 自然語言處理的 Threads 串文,更是高度豐富能驅動 AI 產出的燃料。

心理標籤:比你更懂你要的情緒價值,並給你秀秀

過去的屬性標籤很單純,分年齡、地區、性別,但現在透過 AI 進行的社會工程,操盤手能做到精準打擊。分析你的行為路徑、興趣模式,你看什麼影片會停下來?哪種標題會讓你忍不住點進去?比你自己還清楚你的「D槽」有哪些喜好內容。什麼議題容易觸動你,引誘你轉傳分享?你手機的螢幕停留區、Like 認同、推崇的話題,就算嘴巴上不說,眼睛也做好了表情管理,你的身體依然很誠實地透過手指,洩漏了你的族群輪廓。或許,看了哪些文章,你會同情地流下幾滴眼淚,都在 AI 的計算當中。

透過數據,AI 能計算出你的情緒開關。針對「恐懼型」使用者,AI 會自動生成關於戰爭、安全或經濟敗壞的深偽(Deepfake)影音,而針對「正義型」使用者,則餵養經過剪輯的假弊案。這種「心理定向投餵」,讓你覺得全世界都在發生這件事,世界已崩壞,我們活在鬼島,其實你只是進入了 AI 搭建的楚門世界。

LINE 群組:社會工程的最後一哩路

當 AI 在 Threads 掃描完畢、在 YouTube 撒網播放後,最後的攻擊會在最封閉隱密的 LINE 群組收網。這裡信任度最高,也是社會工程最容易成功的地方。

操盤手不再需要派真人潛伏,網軍臥底的調研,他們用 AI 模擬出熱血鐵粉或隔壁鄰居的口吻,在群組內興風作浪散布客製化的假指令,這類的意圖改變認知的假風向。早在幾年前生成式 AI 被商業化的開始,在 Facebook、YouTube、Google 商家評論等網路平台,就不斷地出現機器人帳號的自動留言。而現在的生成式 AI ,更能讀懂人心,給予豐厚的情緒價值,再加上 AI 學習群組對話的語法習慣,網路選戰可能的應用:AI 發出的緊急配票或某人退選訊息,會像病毒一樣在封閉空間內瞬間炸開,讓你連查證的機會都沒有。畢竟走到馬路上,大家的標語都是需要......急救、搶救!傾家蕩產,只差你一票!

認知的覺醒:用真人溫度對抗機器人冰冷的演算法

當手指被 AI 利用,當社群帳號被平台出賣,面對這種 AI 化、規模化的社會工程攻擊,我們該怎麼辦?答案其實在我們親民黨的傳統裡:「回歸真實、務實的現場哲學」。

AI 可以模擬聲音、可以偽造圖片、甚至可以預判你的情緒,給你滿滿滿的情緒價值,花言巧語的,歌頌到你臉紅的快滴出血。但它唯獨無法模擬「面對面握手時的汗水」與「真實服務的眼神」。在九紫離火這個虛實難辨的時代,越是數位化的攻擊,越要用物理性的確認來反制。別讓演算法決定你的投票意願,請相信你親眼所見的服務,那才是 AI 永遠修不到的學分。身為選民,讓你的腦袋真正的「當家做主」。

最後,我請 Google AI Gemini 針對以上內容,即時撰寫一篇媒體報導。當 AI 穿上專業記者的外衣時,它如何重塑我們的認知:

【深度報導】AI 讀心術入侵!劉吉拉:Threads 已成認知作戰的「人格資料庫」

【2026/02/15 台北訊】 隨著 2026 年選舉進入白熱化,選戰攻防已從實體造勢轉移至無形的數位心理戰。傑愛得資訊網路行銷顧問劉吉拉指出,當前最頂尖的社會工程師不再破解主機,而是透過 AI 爬取「脆」(Threads)上的文字,將用戶的碎碎念與焦慮轉化為最純粹的「人格樣本」。

文字即情緒:Threads 成為心理掃描儀

劉吉拉分析,Threads 憑藉其高度公開性與強烈的情緒表達,成為 AI 進行自然語言處理(NLP)的絕佳燃料。透過大數據監測,AI 能精準繪製「情緒地圖」:

心理標籤化: 經常發表憤怒評論者被標記為「易受激怒型」,感傷者則被列為「情感勒索型」。

精準狙擊: 操盤手利用這些標籤進行「心理定向投餵」,針對恐懼型選民散布關於經濟敗壞或戰爭的深偽(Deepfake)影音。

收網關鍵:LINE 群組的最後一哩路

劉吉拉警告,認知作戰的終點通常在封閉的 LINE 群組。AI 現在能模擬熱血粉絲或隔壁鄰居的口吻,在群組內興風作浪,甚至發布「緊急配票」或「某人退選」等客製化假指令,利用熟人信任感瞬間引爆風向。

顧問建言:用「真實溫度」反制冷冽演算法

面對規模化的 AI 攻擊,劉吉拉建議選民應秉持「現場哲學」。在虛實難辨的「九紫離火」時代,越是數位化的攻擊,越需靠物理性的確認來反制。他呼籲:「AI 永遠無法模擬握手時的汗水與真實服務的眼神。」選民應相信親眼所見的服務,讓大腦真正「當家做主」,別讓演算法決定你的投票意願。

記者 Google Gemini 台北報導

再獻上一首我與 Gemini 協作的詩來做為總結:

【2026 數位覺醒詩】

二零二六選舉瘋,機器學習顯神通。

脆上碎念被利用,字裡行間露行蹤。

賴群訊息遭偽裝,鄰居口吻最難防。

兩岸衝突造心慌,深偽影音亂心房。

九紫離火虛實幻,現場哲學是良方。